网站误封Robots该如何处理

robots文件是搜索生态中很重要的一个环节,同时也是一个很细节的环节。很多站长同学在网站运营过程中,很容易忽视robots文件的存在,进行错误覆盖或者全部封禁robots,造成不必要损失!

那么如果误操作封禁了robots怎么办?今天我们请到了厦门258网站运营负责人——郑军伟,为我们分享网站robots误封禁后该如何操作?

【案例背景】

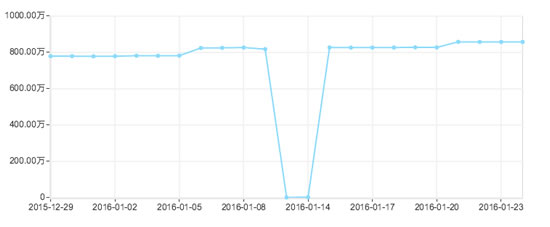

网站开发2.0版本,技术选择了在线开发,为了避免搜索引擎抓取开发版本,要求技术人员设置了Robots封禁处理。2.0版本开发周期1个月,1个月后网站版本迭代,直接覆盖了1.0版本,包括Robots封禁文件,2天后发现流量大幅下降,检查收录发现800万收录降至0条,关键词大量掉线。

【处理方式】

1.修改Robots封禁为允许,然后到百度站长后台检测并更新Robots。

2.在百度站长后台抓取检测,此时显示抓取失败,没关系,多点击抓取几次,触发蜘蛛抓取站点。

3.在百度站长后台抓取频次,申请抓取频次上调。

4.百度反馈中心,反馈是因为误操作导致了这种情况的发生。

5.百度站长后台链接提交处,设置数据主动推送(实时)。

6.更新sitemap网站地图,重新提交百度,每天手工提交一次。

以上处理完,接下来就是等待了,万幸,2天的时间数据开始慢慢回升,到第3天基本回升到正常状态!

【案例总结】

本次事故绝对是运营生涯的一次败笔,总结反思一下,希望大家避免类似问题。

1.产品开发一定要避免在线开发,不能为了省事不搭建开发环境。

2.产品迭代要有流程记录,开发时做了那些设置处理,那些是不需要放出来的,那些是必须放出来的,要非常清楚。

3.要经常关注百度站长后台,关注相关数据变化,从数据变化中及时发现问题

转载:http://zhanzhang.baidu.com/college/articleinfo?id=796